Είναι... σχεδόν αδύνατο να επισκεφθεί κανείς οποιοδήποτε τεχνολογικό website τους τελευταίους μήνες χωρίς να συναντήσει ειδήσεις και σχόλια σχετικά με το περίφημο ChatGPT, την εφαρμογή απόδοσης απαντήσεων σε ερωτήσεις πεφρασμένες σε φυσική γλώσσα που ανέπτυξε η εταιρεία OpenAI βασισμένη στο μοντέλο επικοινωνίας τεχνητής νοημοσύνης GPT (στην 4η πια έκδοσή του). Οι δυνατότητες της εφαρμογής έχουν εντυπωσιάσει πολλούς, κάτι όμως που κανείς δεν περίμενε ήταν το πόσο γρήγορα η Microsoft (στρατηγικός επενδυτής στην OpenAI) θα υιοθετούσε το μοντέλο αυτό σε προϊόντα της. Το ChatGPT ήταν διαθέσιμο σε δοκιμαστική μορφή ως τμήμα της υπηρεσίας αναζήτησης Bing από τον Φεβρουάριο, μόλις ενσωματώθηκε στον web browser της εταιρείας, τον Edge, ως αναπόσπαστο εργαλείο του και θα έχει την ίδια χρησιμότητα σύντομα στο δικτυακό Office 365.

Αυτά, όμως, είναι μόνο η αρχή, καθώς το μεγαλύτερο και τολμηρότερο βήμα της Microsoft προς την υιοθέτηση του μοντέλου τεχνητής νοημοσύνης GPT4 "βρίσκεται ακόμη μπροστά". Το πρόβλημα: ο αμερικανικός κολοσσός όχι μόνο δεν δείχνει να έχει "μετρήσει" σε ικανοποιητικό βαθμό τις πιθανές συνέπειες του βήματος αυτού, αλλά δεν δίνει την εντύπωση πως ενδιαφέρεται να το κάνει.

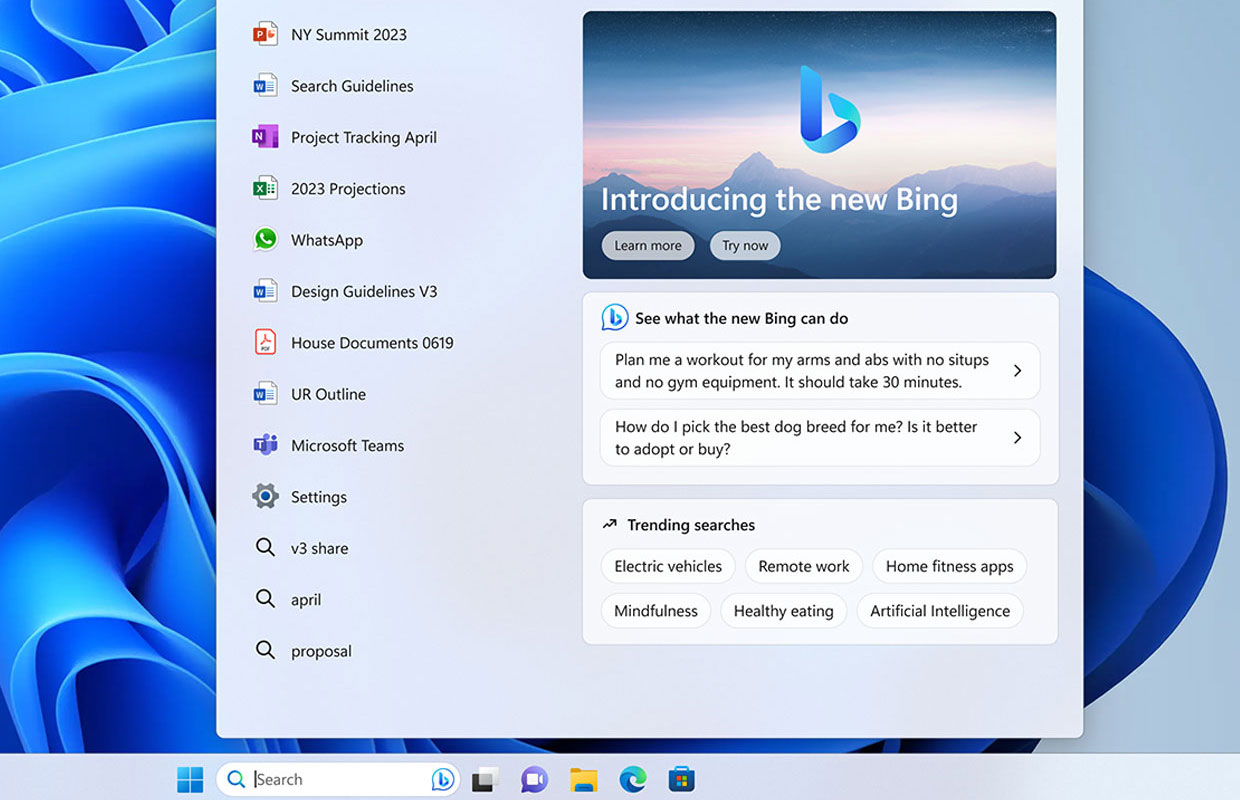

Αναφερόμαστε, φυσικά, στην πρόθεση της Microsoft να ενσωματώσει τον μηχανισμό αναζήτησης πληροφοριών που αξιοποιεί το Bing (και βασίζεται στο ChatGPT4) όχι απλώς στον Edge (τον οποίο μπορεί να μην χρησιμοποιεί κανείς αν θέλει), αλλά... στα ίδια τα Windows 11, ως δική τους λειτουργία. Πράγματι: σε επόμενη ενημέρωση του πιο πρόσφατου λειτουργικού της συστήματος, θα προστεθεί πεδίο αναζήτησης με μόνιμη, περίοπτη θέση στην γραμμή εργασιών (taskbar) ακριβώς κάτω από το Start Menu που χρησιμοποιεί καθημερινά κάθε κάτοχος PC με Windows 11. Δεν έχει ακόμη διευκρινιστεί αν θα είναι υποχρεωτική η εγκατάσταση της συγκεκριμένης ενημέρωσης λογισμικού (υποθέτουμε πως θα καταλήξει να είναι), αν αυτός ο μηχανισμός αναζήτησης θα μπορεί να απενεργοποιηθεί ή αν οι καταναλωτές θα έχουν εικόνα του τί συμβαίνει στα προσωπικά δεδομένα που συλλέγει κατά την χρήση του.

Κάτω από κανονικές συνθήκες θα υποστηρίζαμε οποιαδήποτε νέα τεχνολογία μπορεί να κάνει ευκολότερη την ζωή των καταναλωτών, είτε αυτή αφορά σε λειτουργικό σύστημα είτε σε ο,τιδήποτε άλλο. Η συγκεκριμένη εξέλιξη, ωστόσο, μπορεί να εξελιχθεί σε τεράστιο πρόβλημα για δύο διαφορετικούς λόγους, οι οποίοι - συνδυαστικά - θα μπορούσαν να αποδειχθούν επιβλαβείς για αμέτρητους ανθρώπους σε ολόκληρο τον κόσμο. Ο πρώτος λόγος είναι ο... προφανής: όπως θα βεβαιώσει οποιοσδήποτε έχει παρακολουθήσει από κοντά το όλο ζήτημα του ChatGPT, η τεχνολογία επικοινωνίας τεχνητής νοημοσύνης στην οποία βασίζεται είναι ακόμη σε δοκιμαστικό στάδιο. Ανολοκλήρωτη. Με ατέλειες και αδυναμίες και περιορισμούς.

Όσο εντυπωσιακό κι αν δείχνει αρχικά, το ChatGPT συχνά δίνει ελλιπείς απαντήσεις, άλλοτε ανακριβείς, ενίοτε "κατασκευασμένες" σε βαθμό που να μην μπορεί να τις εμπιστευτεί κανείς "ως έχουν". Πάρα πολλοί χρήστες έχουν δημοσιεύσει παραδείγματα αλληλεπίδρασης με το ChatGPT όπου έδωσε ξεκάθαρα ψεύτικες και λανθασμένες απαντήσεις, ακόμη και σε σχετικά απλές ερωτήσεις, προσθέτοντας "γεγονότα" που δεν συνέβησαν ποτέ και "πληροφορίες" που δεν έχουν καμία ρεαλιστική βάση. Υπάρχουν ολόκληρα θέματα δημοσιευμένα στο Reddit με χρήστες που... ρεζιλεύουν επί τούτου το ChatGPT για διασκέδαση, με άλλους τόσους φυσικά να εκφράζουν μεγάλο προβληματισμό σχετικά με το πόσο εύκολο είναι κάτι τέτοιο. Πολλοί δημοσιογράφοι και αναλυτές έχουν ήδη δημοσιεύσει πάρα πολλά άρθρα σχετικά με το πώς αυτό το εργαλείο είναι "ανώριμο" και πώς "πρέπει να χρησιμοποιείται με προσοχή", καθώς και πώς - σε κάθε περίπτωση - οι πληροφορίες που παρέχει θα πρέπει να ελέγχονται και να επαληθεύονται από άνθρωπο πριν χρησιμοποιηθούν για ο,τιδήποτε.

Η Microsoft ωστόσο σκοπεύει, παρ' όλα αυτά, να τοποθετήσει αυτό το... αθώο με την πρώτη ματιά πεδίο αναζήτησης μπροστά στα μάτια σχεδόν 300.000.000 καταναλωτών (σύμφωνα με τα πιο πρόσφατα στοιχεία της Statcounter για την πελατειακή βάση των Windows 11). Είναι πρακτικά βέβαιο πως πολύ μικρό ποσοστό από αυτούς γνωρίζει τα παραπάνω, έχει ήδη χρησιμοποιήσει το ChatGPT και έχει σαφή εικόνα των περιορισμών του. Οι πιο πολλοί "απλοί χρήστες" θα εισάγουν μία ερώτηση σε φυσική γλώσσα μέσα σε αυτό το πεδίο αναζήτησης αναμένοντας πως η απάντηση που θα πάρουν θα προέρχεται από αξιόπιστη πηγή και οι πληροφορίες που θα περιέχει θα είναι σωστές. Η απάντηση θα φαίνεται πως προσφέρεται, στο κάτω-κάτω, από το ίδιο το λειτουργικό σύστημα των Windows και κατ' επέκταση από την Microsoft, έτσι δεν είναι;

Τί θα συμβεί, λοιπόν, αν κάποιος ζητήσει απαντήσεις σε ερωτήσεις σχετικές με μία σχολική εργασία και λάβει πληροφορίες που δεν είναι σωστές; Τί θα συμβεί αν αυτές οι πληροφορίες προορίζονται να χρησιμοποιηθούν π.χ. για δουλειά, επηρρεάζοντας έτσι κι άλλους ανθρώπους; Τί θα συμβεί αν κάποιος ψάξει για λύση σε πρόβλημα ιατρικό και λάβει απάντηση που δεν είναι επιστημονικά τεκμηριωμένη; Τί θα συμβεί αν κάποιος ψάξει μέσα σε πανικό πληροφορίες για κάτι όπως π.χ. μια τροφική δηλητηρίαση ή ένα δάγκωμα φιδιού ή ένα εγκεφαλικό; Τί θα συμβεί αν οι πληροφορίες που λάβει δεν είναι σωστές κι έχουν δυσμενείς συνέπειες; Ποιός θα φταίει γι' αυτό; Η Microsoft; Η OpenAI; Σίγουρα όχι το ίδιο το ChatGPT, το οποίο δεν θα είναι καν σε θέση να καταλάβει πως η απάντησή του ήταν λανθασμένη!

Η μεγάλη διαφορά ανάμεσα στην μέχρι σήμερα χρήση του ChatGPT και σε αυτήν που οδηγούν τα σχέδια της Microsoft είναι αυτή: ως τώρα έπρεπε ο καταναλωτής να πάει ο ίδιος να αναζητήσει αυτό το εργαλείο για να το χρησιμοποιήσει. Αν το έκανε μέσα από το website της OpenAI, έπρεπε να συνδεθεί με όνομα και κωδικό. Αν το έκανε μέσω του "AI Bing", έπρεπε να έχει εγγραφεί στην δοκιμαστική του λειτουργία και να ενεργοποιήσει τον Edge για να το χρησιμοποιήσει. Με το ChatGPT όμως σε σταθερή θέση στην γραμμή εργασιών των Windows 11, βρίσκεται μόνιμα μπροστά στα μάτια εκατοντάδων εκατομμυρίων καταναλωτών και κυριολεκτικά "ένα κλικ μακριά" από την χρήση του, είτε αυτοί γνωρίζουν την δοκιμαστική του φύση, τις ατέλειες και τους περιορισμούς του, είτε όχι. Και από αυτούς που τα γνωρίζουν όλα αυτά, πόσοι θα γνωρίζουν πώς να απενεργοποιήσουν αυτήν την λειτουργία (αν γίνεται) και, αν γίνεται, πόσοι θα μπουν στην διαδικασία (ας θυμηθούμε τις συνήθειες του ευρύτερου κοινού όσον αφορά στις εξ ορισμού ρυθμίσεις των Windows) να το κάνουν;

Tην Microsoft δεν δείχνουν να την απασχολούν όλα αυτά ούτε στο ελάχιστο, αν κρίνει οποιοσδήποτε από το πόσο επιθετικά προωθεί ήδη την χρήση του "AI Bing" μέσα στον Edge. Η εταιρεία δεν αναφέρει ποτέ και πουθενά ότι το ChatGPT είναι στην ουσία δοκιμαστικό λογισμικό (beta software) και πως αυτό που θέλει να κάνει θα καταστήσει πολλά εκατομμύρια χρήστες των Windows 11 ουσιαστικά beta testers χωρίς να το συνειδητοποιούν (ή να έχουν δώσει σχετική συγκατάθεση). Η ενσωμάτωση, σε αυτήν την χρονική στιγμή, του ChatGPT με αυτόν τον τρόπο στα Windows 11 - πάντοτε με στόχο να προωθήσει η Microsoft τα δικά της προϊόντα και υπηρεσίες έναντι των ανταγωνιστικών - είναι μία επιλογή αλαζονική και ανεύθυνη. Γίνεται, δε, σε κλίμακα κυριολεκτικά ανήκουστη και θα έχει ενδιαφέρον να δούμε πώς ακριβώς θα διαχειριστεί ο αμερικανικός κολοσσός τις όποιες επιπλοκές προκύψουν σχεδόν νομοτελειακά.

Πέρα, ωστόσο, από τις όποιες επιπλοκές, υπάρχουν όσον αφορά στην τεχνητή νοημοσύνη ορισμένες "κόκκινες γραμμές" ηθικής της χρήσης της που δεν μπορούν έτσι απλά να καταπατώνται για να ικανοποιήσουν την φιλοδοξία κάποιων εταιρικών στελεχών ή να επιτύχουν συγκεκριμένους στόχους και μερίδια αγοράς. Κι αυτό γιατί οι μακροπρόθεσμες συνέπειες αυτών των επιλογών είναι κατά πολύ σημαντικότερες από τους βραχυπρόθεσμους στόχους μερικών ανθρώπων ή μιας εταιρείας. Κρίνοντας από το τί σχεδιάζει να κάνει η Microsoft με το ChatGPT και τα Windows 11, είναι να αναρωτιέται κανείς αν έχει απομείνει στα κεντρικά γραφεία της στο Redmond οποιοσδήποτε που έχει όντως συναίσθηση αυτής της ανευθυνότητας κι αυτών των επιλογών.